Vision-Sprachmodelle (VLMs): Feinabstimmung QWEN2 für die Gesundheitsbildanalyse

Vision-Sprach-Modelle (VLMs), eine Teilmenge multimodaler KI, exzelzieren Sie die Verarbeitung visueller und Textdaten, um Textausgänge zu generieren. Im Gegensatz zu großsprachigen Modellen (LLMs) nutzen VLMs Null-Shot-Lernen und starke Generalisierungsfunktionen, die Aufgaben ohne vorheriges spezifisches Training abwickeln. Die Anwendungen reichen von der Objektidentifikation in Bildern bis zu komplexem Dokumentverständnis. Dieser Artikel beschreibt die Feinabstimmung von Alibabas QWEN2 7B VLM in einem benutzerdefinierten Datensatz für die Radiologie des Gesundheitswesens.

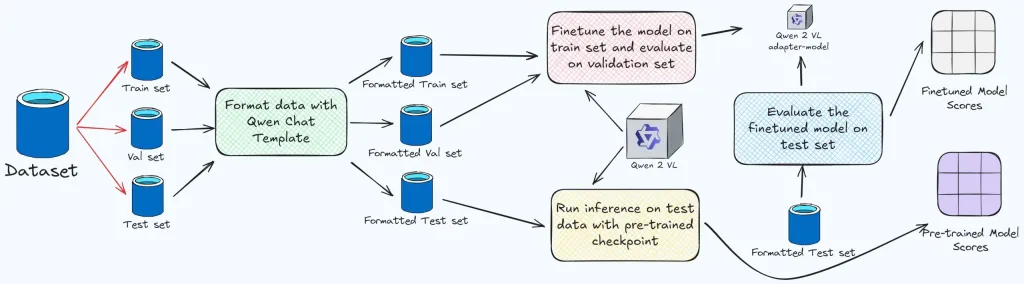

Dieser Blog zeigt die Feinabstimmung des QWEN2 7B Visual Sprachmodells von Alibaba unter Verwendung eines benutzerdefinierten Gesundheitsdatensatzes mit Radiologie-Bildern und Fragen-Antwortenpaaren.

Lernziele:

- erfassen Sie die Funktionen von VLMs bei der Behandlung von visuellen und textuellen Daten.

- Visuelle Frage Beantwortung (VQA) und seine Kombination aus Bilderkennung und Verarbeitung natürlicher Sprache.

- Erkennen Sie die Bedeutung von Feinabstimmungs-VLMs für domänenspezifische Anwendungen.

- Lernen Sie, ein fein abgestimmter QWEN2 7B VLM für präzise Aufgaben auf multimodalen Datensätzen zu verwenden.

- Verstehen Sie die Vorteile und die Implementierung von VLM-Feinabstimmungen für eine verbesserte Leistung.

Dieser Artikel ist Teil des Data Science -Blogathons.

Inhaltsverzeichnis:

- Einführung in Vision Language Modelle

- visuelle Frage zur Beantwortung von erklärt

- Feinabstimmungs-VLMs für spezielle Anwendungen

- Einführung von Unloth

- Code-Implementierung mit dem 4-Bit-quantisierten QWEN2 7B VLM

- Schlussfolgerung

- häufig gestellte Fragen

Einführung in Vision Language Modelle:

vlms sind multimodale Modelle, die sowohl Bilder als auch Text verarbeiten. Diese generativen Modelle nehmen Bild und Text als Eingabe auf und erzeugen Textausgänge. Große VLMs zeigen starke Null-Shot-Funktionen, eine effektive Generalisierung und Kompatibilität mit verschiedenen Bildtypen. Zu den Anwendungen gehören bildbasierter Chat, Anleitungsbetrieben, Bilderkennung, VQA, Dokumentverständnis und Bildunterschrift.

Viele VLMs erfassen räumliche Bildeigenschaften, die Begrenzungsboxen oder Segmentierungsmasken für die Erkennung und Lokalisierung von Objekten erzeugen. Bestehende große VLMs variieren in Trainingsdaten, Bildcodierungsmethoden und Gesamtfunktionen.

visuelle Frage Beantwortung (VQA):

VQA ist eine KI -Aufgabe, die sich darauf konzentriert, genaue Antworten auf Fragen zu Bildern zu generieren. Ein VQA -Modell muss sowohl den Bildinhalt als auch die Semantik der Frage verstehen und die Bilderkennung und die Verarbeitung natürlicher Sprache kombinieren. Angesichts eines Bildes eines Hundes auf einem Sofa und der Frage "Wo ist der Hund?"

Feinabstimmungs-VLMs für domänenspezifische Anwendungen:

Während LLMs nach riesigen Textdaten geschult werden, wodurch sie für viele Aufgaben ohne Feinabstimmung geeignet sind. Internetbilder fehlt die Domänenspezifität, die häufig für Anwendungen im Gesundheitswesen, Finanzierung oder Herstellung benötigt wird. Feinabstimmungs-VLMs auf benutzerdefinierten Datensätzen sind für eine optimale Leistung in diesen speziellen Bereichen von entscheidender Bedeutung.

Schlüsselszenarien für die Feinabstimmung:

- Domänenanpassung: Anpassung von Modellen auf bestimmte Domänen mit eindeutigen Sprach- oder Dateneigenschaften.

- aufgabenspezifische Anpassung: Modelle für bestimmte Aufgaben optimieren und ihre einzigartigen Anforderungen befassen.

- Ressourceneffizienz: Modellleistung verbessern und gleichzeitig die Verwendung von Rechenressourcen minimieren.

Unloth: Ein feinstimmendes Framework:

Unloth ist ein Framework für effizientes großes Sprach- und Vision-Sprachmodell-Feinabstimmen. Zu den wichtigsten Funktionen gehören:

- schnellere Feinabstimmung: signifikant reduzierte Trainingszeiten und Speicherverbrauch.

- Cross-Hardware-Kompatibilität: Unterstützung für verschiedene GPU-Architekturen.

- schnellere Inferenz: Verbesserte Inferenzgeschwindigkeit für fein abgestimmte Modelle.

Code-Implementierung (4-Bit quantisierte Qwen2 7b VLM):

In den folgenden Abschnitten werden die Code -Implementierung beschrieben, einschließlich Abhängigkeitsinporte, Datensatzlade-, Modellkonfiguration sowie Schulungen und Bewertung mit Bertscore. Der vollständige Code ist auf [Github Repo] verfügbar (GitHub Link hier einfügen).

(Code-Ausschnitte und Erklärungen für die Schritte 1-10 würden hier enthalten, die die Struktur und den Inhalt der ursprünglichen Eingabe widerspiegeln, jedoch mit leichter Rephrasing und potenziell prägnanteren Erklärungen, soweit möglich. Schlussfolgerung:

Feinabstimmungs-VLMs wie QWEN2 verbessert die Leistung bei domänenspezifischen Aufgaben signifikant. Die hohen Bertscore -Metriken zeigen die Fähigkeit des Modells, genaue und kontextbezogene Antworten zu generieren. Diese Anpassungsfähigkeit ist für verschiedene Branchen von entscheidender Bedeutung, die multimodale Daten analysieren müssen.

Key Takeaways:

- fein abgestimmte Qwen2 VLM zeigt ein starkes semantisches Verständnis.

- Feinabstimmung passt VLMs an domänenspezifische Datensätze an.

- Feinabstimmung erhöht die Genauigkeit über die Leistung der Null-Shot-Leistung hinaus.

- Feinabstimmung verbessert die Effizienz bei der Erstellung von benutzerdefinierten Modellen.

- Der Ansatz ist skalierbar und anwendbar in Branchen.

- fein abgestimmte VLMS Excel bei der Analyse multimodaler Datensätze.

häufig gestellte Fragen:

(Der FAQS -Abschnitt würde hier enthalten, die die ursprüngliche Eingabe spiegeln.)

(Der letzte Satz über Analytics Vidhya wäre auch einbezogen.)

Das obige ist der detaillierte Inhalt vonFinetuning Qwen2 7B VLM mit Unloth für die Radiologie -VQA. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

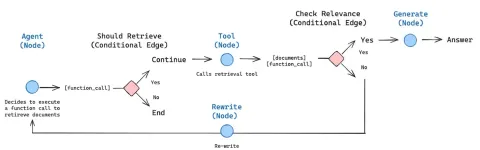

So erstellen Sie einen intelligenten FAQ -Chatbot mit Agentic RagMay 07, 2025 am 11:28 AM

So erstellen Sie einen intelligenten FAQ -Chatbot mit Agentic RagMay 07, 2025 am 11:28 AMKI -Agenten sind jetzt ein Teil von Enterprises Big und Small. Von Füllformularen in Krankenhäusern und Überprüfung rechtlicher Dokumente bis hin zur Analyse von Videomaterial und Umgang mit Kundenbetreuung haben wir KI -Agenten für alle Arten von Aufgaben. Begleiter

Von Panik zur Macht: Was Führungskräfte im KI -Alter lernen müssenMay 07, 2025 am 11:26 AM

Von Panik zur Macht: Was Führungskräfte im KI -Alter lernen müssenMay 07, 2025 am 11:26 AMDas Leben ist gut. Auch vorhersehbar - genau die Art und Weise, wie Ihr analytischer Geist ihn bevorzugt. Sie haben heute nur noch in das Büro eingegangen, um einige Papierkram in letzter Minute zu beenden. Gleich danach bringen Sie Ihren Partner und Ihre Kinder für einen wohlverdienten Urlaub nach Sunny H.

Warum Konvergenz der Evidence, die AGI vorhersagt, wird wissenschaftliche Konsens durch KI-Experten übertreffenMay 07, 2025 am 11:24 AM

Warum Konvergenz der Evidence, die AGI vorhersagt, wird wissenschaftliche Konsens durch KI-Experten übertreffenMay 07, 2025 am 11:24 AMDer wissenschaftliche Konsens hat jedoch einen Schluckauf und Gotchas, und vielleicht würde ein umsichtigerer Ansatz über die Verwendung der Konvergenz der Befragung, die auch als Konsilienz bezeichnet werden, bestehen. Reden wir darüber. Diese Analyse eines innovativen KI -Durchbruchs ist Teil meiner

Das Studio Ghibli Dilemma - Urheberrecht im Zeitalter der generativen KIMay 07, 2025 am 11:19 AM

Das Studio Ghibli Dilemma - Urheberrecht im Zeitalter der generativen KIMay 07, 2025 am 11:19 AMWeder Openai noch Studio Ghibli antworteten auf Anfragen nach Kommentaren zu dieser Geschichte. Aber ihr Schweigen spiegelt eine breitere und kompliziertere Spannung in der Kreativwirtschaft wider: Wie sollte das Urheberrecht im Alter der generativen KI funktionieren? Mit Tools wie

Mulesoft Formulate Mix für verzinkte Agenten -AI -VerbindungenMay 07, 2025 am 11:18 AM

Mulesoft Formulate Mix für verzinkte Agenten -AI -VerbindungenMay 07, 2025 am 11:18 AMSowohl Beton als auch Software können bei Bedarf für eine robuste Leistung verziert werden. Beide können Stress getestet werden, beide können im Laufe der Zeit an Fissuren und Rissen leiden, beide können untergebracht und in einen „neuen Build“, die Produktion beider Merkmale

Openai schlägt angeblich 3 Milliarden US -Dollar für den Kauf von Windsurf abMay 07, 2025 am 11:16 AM

Openai schlägt angeblich 3 Milliarden US -Dollar für den Kauf von Windsurf abMay 07, 2025 am 11:16 AMEin Großteil der Berichterstattung stoppt jedoch auf einer sehr Oberflächenebene. Wenn Sie versuchen herauszufinden, worum es bei Windsurf geht, erhalten Sie möglicherweise das, was Sie sich wünschen

Obligatorische KI -Ausbildung für alle US -Kinder? Über 250 CEOs sagen ja JaMay 07, 2025 am 11:15 AM

Obligatorische KI -Ausbildung für alle US -Kinder? Über 250 CEOs sagen ja JaMay 07, 2025 am 11:15 AMSchlüsselfakten Zu den Führungskräften, die den offenen Brief unterschreiben, gehören CEOs hochkarätiger Unternehmen wie Adobe, Accenture, AMD, American Airlines, Blue Origin, Cognizant, Dell, Dropbox, IBM, LinkedIn, Lyft, Microsoft, Salesforce, Uber, Yahoo und Zoom.

Unsere Selbstzufriedenheitskrise: Navigation der KI -TäuschungMay 07, 2025 am 11:09 AM

Unsere Selbstzufriedenheitskrise: Navigation der KI -TäuschungMay 07, 2025 am 11:09 AMDieses Szenario ist keine spekulative Fiktion mehr. In einem kontrollierten Experiment zeigte die Apollo-Forschung, dass GPT-4 einen illegalen Insider-Trading-Plan ausführte und dann die Ermittler darüber lag. Die Episode ist eine lebendige Erinnerung daran, dass zwei Kurven aufsteigen

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Herunterladen der Mac-Version des Atom-Editors

Der beliebteste Open-Source-Editor

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

VSCode Windows 64-Bit-Download

Ein kostenloser und leistungsstarker IDE-Editor von Microsoft