Deepseek veröffentlicht Deepgemm: eine Hochleistungs-FP8-Gemm-Bibliothek für Ai

als Teil von #OpenSourceWeek enthüllte Deepseek DeepGemm, eine modernste Bibliothek, die für effiziente FP8-allgemeine Matrix-Multiplikationen (GEMMs) optimiert wurde. Diese Bibliothek unterstützt sowohl Dicht- als auch Mischungsprogramme (MEE-Experten). DeepGemm zielt darauf ab, die Leistung und Effizienz bei KI-Arbeitsbelastungen erheblich zu steigern und Deepseeks Engagement für Open-Source-Innovation zu verstärken.

? Tag 3 von #OpenSourceWeek: DeepGemm

Einführung von DeepGemm - eine FP8 -Gemmm -Bibliothek, die dichte und Moe -Gemms unterstützt, ein V3/R1 -Training und die Inferenz.

⚡ bis zu 1350 fp8 tflops auf Hopper gpus

✅ Minimale Abhängigkeiten, ausgelegt für die Benutzerfreundlichkeit

✅ Ganz in der Zeit zusammengestellt…- Deepseek (@deepseek_ai) 26. Februar 2025

Diese Veröffentlichung folgt den erfolgreichen Starts von Deepseek FlashML (Tag 1) und Deepseek Deepp (Tag 2).

Inhaltsverzeichnis

- Was ist Gemm?

- Was ist fp8?

- Die Notwendigkeit von Deepgemm

- Schlüsselmerkmale von DeepGemm

- Performance Benchmarks

- Installationsanweisungen

- Schlussfolgerung

Was ist Gemm?

Allgemeine Matrix -Multiplikation (GEMM) ist ein grundlegender linearer Algebra -Betrieb, der zwei Matrizen multipliziert, um ein Drittel zu erzeugen. In zahlreichen Anwendungen häufig verwendet, ist seine Formel:

GEMM ist entscheidend für die Modellleistung der Modellleistung, insbesondere für das Tiefenlernen für das Training und die Inferenz für neuronale Netzwerke.

Diese Illustration zeigt GEMM, das Kacheln (Teilen von Matrizen in kleinere Blöcke - mtile, ntile, ktile) zur optimierten Cache -Nutzung hervorhebt. Dies verbessert die Leistung durch verbesserte Datenlokalität und -parallelität.

Was ist fp8?

FP8 (8-Bit-Gleitpunkt) ist ein Hochleistungs-Computing-Format, das eine verringerte Präzision und eine effiziente numerische Datendarstellung bietet. Es ist besonders vorteilhaft für den Umgang mit den Rechenanforderungen großer Datensätze im maschinellen Lernen.

Das typische FP8 -Format enthält:

- 1 Zeichen bit

- 5 Exponent Bits

- 2 Fraktionsbits

Diese kompakte Struktur ermöglicht schnellere Berechnungen und reduzierter Speicherverbrauch, ideal für das Training großer Modelle. Während Präzision möglicherweise geringfügig beeinträchtigt wird, ist dies häufig akzeptabel, selbst wenn es zu Leistungsgewinnen aufgrund reduzierter Rechenaufwand führt.

Dieses Bild vergleicht FP8 (E4M3- und E5M2-Formate) mit FP16 und BF16 und veranschaulicht die Kompromisse zwischen Präzision und Bereich für verschiedene Gleitpunktformate.

Das Bedürfnis nach Deepgemm

DeepGemm befasst sich mit den Herausforderungen der Matrix-Multiplikationen, indem sie eine leichte, leistungsstarke und benutzerfreundliche Bibliothek für verschiedene GEMM-Operationen anbieten.

- erfüllt einen kritischen Bedarf an optimiertem FP8 GEMM in der AI -Community.

- hohe Leistung mit einem kleinen Speicherpfunddruck.

- unterstützt sowohl dichte als auch MOE -Layouts.

- entscheidend für groß angelegte KI-Modelltraining und -ausführung.

- optimiert MOE -Architekturen mit speziellen Gemmm -Typen.

- verbessert die KI -Modelle von Deepseek direkt.

- kommt dem breiteren AI -Entwicklungs -Ökosystem zugute.

Schlüsselmerkmale von DeepGemm

DeepGemms Stärken umfassen:

- hohe Leistung: erreicht bis zu 1350 fp8 tflops auf nvidia Hopper gpus.

- Leichtes Design: Minimale Abhängigkeiten für die vereinfachte Verwendung.

- Just-in-Time-Zusammenstellung: Kompiliert Kernel zur Laufzeit für optimierte Benutzererfahrung.

- präzise Kernlogik: ungefähr 300 Zeilen des Kerncode, die viele erfahrene Kernel übertreffen.

- Unterstützung für verschiedene Layouts: Unterstützt dichte und zwei MOE -Layouts.

Leistungsbenchmarks

Die Effizienz vonDeepGemm über verschiedene Matrixkonfigurationen ist unten gezeigt:

| M | N | K | Computation | Memory Bandwidth | Speedup |

|---|---|---|---|---|---|

| 64 | 2112 | 7168 | 206 TFLOPS | 1688 GB/s | 2.7x |

| 128 | 7168 | 2048 | 510 TFLOPS | 2277 GB/s | 1.7x |

| 4096 | 4096 | 7168 | 1304 TFLOPS | 500 GB/s | 1.1x |

Tabelle 1: DeepGemm Performance Benchmarks

Installationsanweisungen

DeepGemm -Installation ist einfach:

Schritt 1: Voraussetzungen

- Hopper Architecture gpus (sm_90a)

- Python 3.8

- CUDA 12.3 (Empfohlen: 12.8)

- pytorch 2.1

- Cutlass 3.6 (kann ein Git -Submodul sein)

Schritt 2: Klon das Repository

git clone --recursive [email protected]:deepseek-ai/DeepGEMM.git

Schritt 3: Installieren Sie die Bibliothek

python setup.py install

Schritt 4: DeepGemm

importierenimport deep_gemm

Siehe das DeepGemm Github -Repository für detaillierte Anweisungen.

Schlussfolgerung

DeepGemm ist eine leistungsstarke, benutzerfreundliche FP8-GEMM-Bibliothek, die ideal für erweiterte maschinelle Lernaufgaben ist. Das leichte Design, die Geschwindigkeit und die Flexibilität machen es zu einem wertvollen Werkzeug für KI -Entwickler. Überprüfen Sie den Analytics Vidhya -Blog, um Updates zu Deepseek's Day 4 Release!

Das obige ist der detaillierte Inhalt vonDeepGemm am dritten Tag der Deek Open Source Week veröffentlicht. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Neueste jährliche Zusammenstellung der besten technischen TechnikenApr 10, 2025 am 11:22 AM

Neueste jährliche Zusammenstellung der besten technischen TechnikenApr 10, 2025 am 11:22 AMFür diejenigen unter Ihnen, die in meiner Kolumne neu sein könnten, erforsche ich allgemein die neuesten Fortschritte in der KI auf dem gesamten Vorstand, einschließlich Themen wie verkörpertes KI, KI-Argumentation, High-Tech

Europas KI -Kontinent -Aktionsplan: Gigafactories, Datenlabors und grüne KIApr 10, 2025 am 11:21 AM

Europas KI -Kontinent -Aktionsplan: Gigafactories, Datenlabors und grüne KIApr 10, 2025 am 11:21 AMDer ehrgeizige Aktionsplan in Europa Continent Continent zielt darauf ab, die EU als weltweit führend in der künstlichen Intelligenz zu etablieren. Ein Schlüsselelement ist die Schaffung eines Netzwerks von AI Gigafactories, in dem jeweils rund 100.000 fortschrittliche KI -Chips enthalten sind - das vierfache Capaci

Ist die unkomplizierte Agent -Geschichte von Microsoft genug, um mehr Fans zu erstellen?Apr 10, 2025 am 11:20 AM

Ist die unkomplizierte Agent -Geschichte von Microsoft genug, um mehr Fans zu erstellen?Apr 10, 2025 am 11:20 AMDer einheitliche Ansatz von Microsoft bei AI -Agentenanwendungen: Ein klarer Sieg für Unternehmen Die jüngste Ankündigung von Microsoft zu neuen KI -Agentenfunktionen beeindruckte von der klaren und einheitlichen Präsentation. Im Gegensatz zu vielen technischen Ankündigungen, die in TE festgefahren sind

Verkauf von KI -Strategie an Mitarbeiter: Shopify -CEO ManifestoApr 10, 2025 am 11:19 AM

Verkauf von KI -Strategie an Mitarbeiter: Shopify -CEO ManifestoApr 10, 2025 am 11:19 AMDas jüngste Memo von Shopify -CEO Tobi Lütke erklärt kühn für jeden Mitarbeiter eine grundlegende Erwartung und kennzeichnet eine bedeutende kulturelle Veränderung innerhalb des Unternehmens. Dies ist kein flüchtiger Trend; Es ist ein neues operatives Paradigma, das in P integriert ist

IBM startet Z17 Mainframe mit vollem KI -IntegrationApr 10, 2025 am 11:18 AM

IBM startet Z17 Mainframe mit vollem KI -IntegrationApr 10, 2025 am 11:18 AMIBMs Z17 Mainframe: Integration von KI für verbesserten Geschäftsbetrieb Letzten Monat erhielt ich im New Yorker Hauptquartier von IBM eine Vorschau auf die Fähigkeiten des Z17. Aufbau des Erfolgs des Z16 (im Jahr 2022 eingeführt und nachweisliche Einnahmen nachweisen

5 CHATGPT -Aufforderungen, abhängig von anderen aufzuhören und sich selbst vollständig zu vertrauenApr 10, 2025 am 11:17 AM

5 CHATGPT -Aufforderungen, abhängig von anderen aufzuhören und sich selbst vollständig zu vertrauenApr 10, 2025 am 11:17 AMSchalte das unerschütterliche Vertrauen frei und beseitige die Notwendigkeit einer externen Validierung! Diese fünf Chatgpt-Eingabeaufforderungen führen Sie zu einer vollständigen Selbstständigkeit und einer transformativen Verschiebung der Selbstwahrnehmung. Einfach kopieren, einfügen und die Klammer anpassen

KI ist Ihnen gefährlich ähnlich wie Ihr GeistApr 10, 2025 am 11:16 AM

KI ist Ihnen gefährlich ähnlich wie Ihr GeistApr 10, 2025 am 11:16 AMEine aktuelle [Studie] von Anthropic, einer Sicherheit für künstliche Intelligenz und Forschungsunternehmen, beginnt die Wahrheit über diese komplexen Prozesse zu offenbaren und zeigt eine Komplexität, die unserer eigenen kognitiven Domäne beunruhigend ähnlich ist. Natürliche Intelligenz und künstliche Intelligenz können ähnlicher sein als wir denken. Snooping Inside: Anthropic Interpretierbarkeitsstudie Die neuen Ergebnisse der von Anthropic durchgeführten Forschungsergebnisse stellen im Bereich der mechanistischen Interpretierbarkeit erhebliche Fortschritte dar, die darauf abzielen, das interne Computer der KI zu verkehren - nicht nur zu beobachten, was KI tut, sondern verstehen, wie es auf künstlicher Neuronebene tut. Stellen Sie sich vor, Sie versuchen, das Gehirn zu verstehen, indem Sie zeichnen, welche Neuronen feuern, wenn jemand ein bestimmtes Objekt sieht oder über eine bestimmte Idee nachdenkt. A

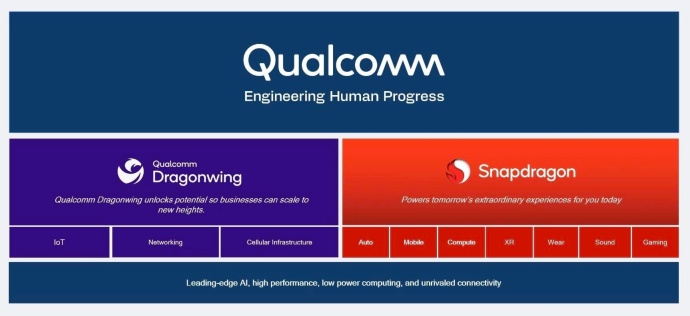

Dragonwing präsentiert Qualcomms Edge -DynamikApr 10, 2025 am 11:14 AM

Dragonwing präsentiert Qualcomms Edge -DynamikApr 10, 2025 am 11:14 AMQualcomms Dragonwing: Ein strategischer Sprung in Unternehmen und Infrastruktur Qualcomm erweitert seine Reichweite über Mobile aggressiv und zielt auf Unternehmens- und Infrastrukturmärkte weltweit mit seiner neuen Dragonwing -Marke ab. Dies ist nicht nur eine Rebran

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

mPDF

mPDF ist eine PHP-Bibliothek, die PDF-Dateien aus UTF-8-codiertem HTML generieren kann. Der ursprüngliche Autor, Ian Back, hat mPDF geschrieben, um PDF-Dateien „on the fly“ von seiner Website auszugeben und verschiedene Sprachen zu verarbeiten. Es ist langsamer und erzeugt bei der Verwendung von Unicode-Schriftarten größere Dateien als Originalskripte wie HTML2FPDF, unterstützt aber CSS-Stile usw. und verfügt über viele Verbesserungen. Unterstützt fast alle Sprachen, einschließlich RTL (Arabisch und Hebräisch) und CJK (Chinesisch, Japanisch und Koreanisch). Unterstützt verschachtelte Elemente auf Blockebene (wie P, DIV),

SublimeText3 Linux neue Version

SublimeText3 Linux neueste Version

Dreamweaver Mac

Visuelle Webentwicklungstools

SublimeText3 Englische Version

Empfohlen: Win-Version, unterstützt Code-Eingabeaufforderungen!

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software