metaclip: Ein überlegenes multimodales AI -Modell, das auf Clips Foundation

bautOpenAs Clip war eine führende Kraft in der künstlichen Intelligenz, die für seine Leistung und Architektur bekannt ist. Auf dem Erfolg von Clip entwickelten Facebook -Forscher Metaclip, ein multimodales Modell, das die Datenkurationsprinzipien von Clip nutzte, jedoch mit verbesserter Transparenz. In diesem Artikel werden die Funktionalität, Leistung und Anwendungen von Metaclip untersucht und seine wichtigsten Verbesserungen gegenüber seinem Vorgänger hervorgehoben.

Schlüssellernen:

- Verstehen Sie die architektonischen Fortschritte von Metaclip über Clip.

- Analysieren Sie die Leistungsbenchmarks von Metaclip.

- die Architektur des Modells erfassen.

- MetaClip implementieren

- Identifizieren Sie die Einschränkungen von Metaclip und die realen Anwendungen.

Was ist MetaClip?

MetaClip, entwickelt von Metaai, stellt einen neuartigen Ansatz für die Vorausbildung von Sprachbildmodellen dar. Unter Verwendung von über 400 Millionen Bild-Text-Paaren, die sorgfältig mit Metadaten zusammengebracht wurden (wie in "demystifizierenden Clip-Daten"), erreicht MetaClip eine hohe Genauigkeit über verschiedene Aufgaben hinweg. Zu den Funktionen gehört das Bildclustering basierend auf Merkmalen wie Form und Farb, Bildvergleich und Text-Image-Matching.

metaClip: Beyond Clip

Um Metaclip vollständig zu schätzen, ist das Verständnis von Clips Einschränkungen von entscheidender Bedeutung. Während die Clip-Pioniernull-Schuss-Klassifizierung im Computer Vision Pionierarbeit leistete, blieb seine Datenbeschaffung undurchsichtig, was die Reproduzierbarkeit und Analyse behinderte. Metaclip befasst sich mit einem metadatengesteuerten Ansatz, wodurch der Datenkurationsprozess zugänglich und transparenter wird.

Leistungsmetriken:

metaclip übertrifft den Clip signifikant über verschiedene Benchmarks. Mit einem 400-Millionen-Bild-Text-Paar-Datensatz erreicht es eine Genauigkeit von ungefähr 70% in der Klassifizierung von Null-Shot-Klassifizierung und übertrifft Clips 68%. Skalieren auf 1 Milliarde Datenpunkte steigern die Genauigkeit weiter auf rund 72%und sogar noch höher (bis zu 80%) in verschiedenen VT -Modellgrößen.

Architekturübersicht:

Metaclips Fundament beruht nicht nur auf Architektur, sondern auf dem akribisch kuratierten Datensatz. Die wichtigsten Prinzipien, die seine Datenkuration leiten, umfassen:

- Ein neuartiger Datensatz von über 400 Millionen Image-Text-Paaren aus verschiedenen Online-Repositories.

- Zuordnung zwischen Metadaten -Texteinträgen und ihren entsprechenden Textinhalten.

- Ein formalisierter Algorithmus für skalierbare und effiziente Datenkuration.

- Eine spezielle Matching -Technik, die unstrukturierter Text und strukturierte Metadaten überbrückt.

- Subjekt Addition zu jedem Eintrag für ausgewogene Datenverteilung und verbesserte Voraussetzung.

Verwendung von MetaClip:

MetaClip übertrifft in Aufgaben wie Null-Shot-Bildklassifizierung und Bildähnlichkeitserkennung. Die folgenden Schritte veranschaulichen die Null-Shot-Bildklassifizierung:

Schritt 1: Bibliotheken importieren

from transformers import pipeline from PIL import Image

Schritt 2: Bildlade

image_path = "/content/Bald doctor.jpeg" image = Image.open(image_path)

Schritt 3: Modellinitialisierung

pipe = pipeline("zero-shot-image-classification", model="facebook/metaclip-b16-fullcc2.5b")

Schritt 4: Beschriftungen

definierencandidate_labels = ["doctor", "scientist", "businessman", "teacher", "artist"]

Schritt 5: Ausgabe

result = pipe(image, candidate_labels=candidate_labels) print(result)

Bild-Text-Ähnlichkeit mit MetaClip:

metaclip bewertet auch die Bildähnlichkeit effizient. Der Prozess beinhaltet das Laden von zwei Bildern, das Bereitstellen von Textbeschreibungen und den Vergleich von Vertrauenswerten. Hohe Werte zeigen Ähnlichkeit an.

Anwendungen und Einschränkungen:

MetaClip findet Anwendungen in Bildsuche, Bildunterschrift, Bilderzeugung und Bildkombination. Zu den Einschränkungen gehören jedoch potenzielle Verzerrungen aus Trainingsdaten, Vertrauen in die Datenqualität, hohe Rechenkosten und Herausforderungen bei der Interpretierbarkeit und ethischen Überlegungen.

Schlussfolgerung:

metaclip stellt einen erheblichen Fortschritt in der multimodalen KI dar und verbessert die Stärken von Clips gleichzeitig mit ihren Schwächen. Die verbesserte Transparenz, die überlegene Leistung und verschiedene Anwendungen machen es zu einem wertvollen Instrument, obwohl ethische Überlegungen weiterhin wichtig sind.

Key Takeaways:

- Verbesserte Datentransparenz durch metadatenbasierte Kuration.

- Überlegene Null-Shot-Bildklassifizierungsleistung.

- vielseitige Anwendungen in bildbezogenen Aufgaben.

Ressourcen: (Links gemäß Anweisungen, aber diese würden hier enthalten)

häufig gestellte Fragen: (Antworten bleiben die gleichen wie im Originaltext)

(Hinweis: Bild -URLs werden wie in der Eingabe angegeben.)

Das obige ist der detaillierte Inhalt vonWie benutze ich MetaClip?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

7 Leistungsstarke KI fordert jeder Projektmanager auf, jetzt zu meisternMay 08, 2025 am 11:39 AM

7 Leistungsstarke KI fordert jeder Projektmanager auf, jetzt zu meisternMay 08, 2025 am 11:39 AMGenerative KI, beispielhaft von Chatbots wie ChatGPT, bietet Projektmanagern leistungsstarke Tools, um Workflows zu optimieren und sicherzustellen, dass Projekte im Zeitplan und im Budget bleiben. Ein effektiver Gebrauch ist jedoch das Erstellen der richtigen Eingabeaufforderungen an. Präzise, Detail

Definieren der schlecht definierten Bedeutung von schwer fassbarem AGI über die hilfreiche Unterstützung der KI selbstMay 08, 2025 am 11:37 AM

Definieren der schlecht definierten Bedeutung von schwer fassbarem AGI über die hilfreiche Unterstützung der KI selbstMay 08, 2025 am 11:37 AMDie Herausforderung, künstliche allgemeine Intelligenz (AGI) zu definieren, ist von Bedeutung. Ansprüche des AGI-Fortschritts fehlen häufig einen klaren Benchmark, wobei Definitionen auf die festgelegten Forschungsrichtungen zugeschnitten sind. Dieser Artikel untersucht einen neuartigen Ansatz für definitiv

IBM Think 2025 präsentiert Watsonx.Datas Rolle in der generativen KIMay 08, 2025 am 11:32 AM

IBM Think 2025 präsentiert Watsonx.Datas Rolle in der generativen KIMay 08, 2025 am 11:32 AMIBM Watsonx.data: Straffung des AI -Datenstapels Enterprise IBM positioniert Watsonx.data als eine entscheidende Plattform für Unternehmen, die darauf abzielen, die Bereitstellung präziser und skalierbarer generativer KI -Lösungen zu beschleunigen. Dies wird erreicht, indem die Beschwerde vereinfacht wird

Der Aufstieg der humanoiden Robotermaschinen nähert sich.May 08, 2025 am 11:29 AM

Der Aufstieg der humanoiden Robotermaschinen nähert sich.May 08, 2025 am 11:29 AMDie schnellen Fortschritte in der Robotik, die durch Durchbrüche in KI und Materialwissenschaft angetrieben werden, sind bereit, eine neue Ära humanoischer Roboter einzuleiten. Seit Jahren steht die industrielle Automatisierung im Hauptaugenmerk, aber die Fähigkeiten von Robotern sind schnell exponiert

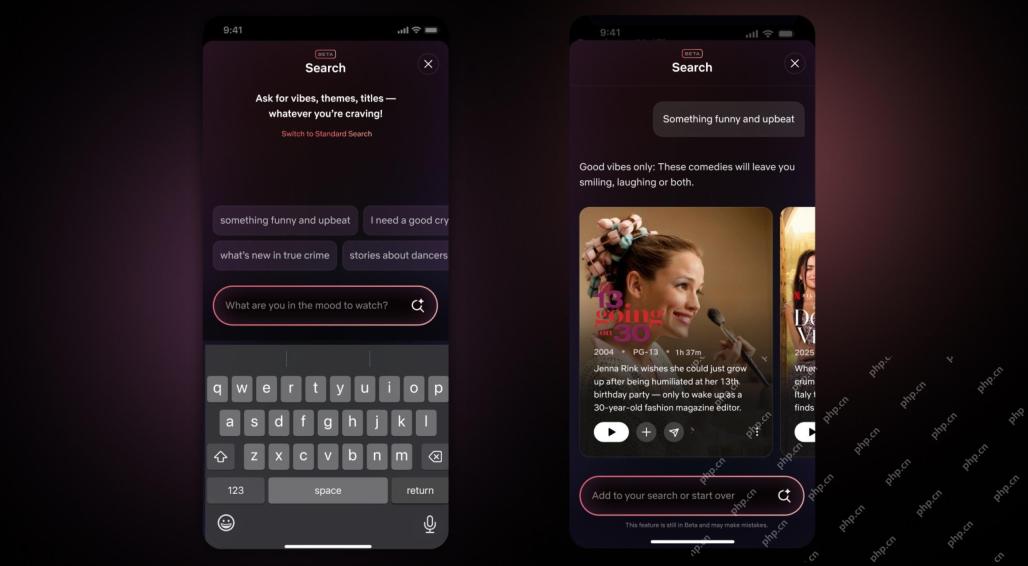

Netflix Revamps Interface-Debüt von KI-Suchwerkzeugen und Tiktok-ähnliches DesignMay 08, 2025 am 11:25 AM

Netflix Revamps Interface-Debüt von KI-Suchwerkzeugen und Tiktok-ähnliches DesignMay 08, 2025 am 11:25 AMDas größte Update der Netflix -Schnittstelle in einem Jahrzehnt: intelligentere, personalisierter, umarme Inhalte Netflix kündigte in einem Jahrzehnt seine größte Überarbeitung seiner Benutzeroberfläche an, nicht nur ein neues Erscheinungsbild, sondern fügt auch weitere Informationen zu jeder Show hinzu und führt intelligenteren KI -Suchwerkzeugen ein, die vage Konzepte wie "Umgebungsstoffe" und flexiblere Strukturen des Unternehmens verstehen können, um das Interesse des Unternehmens an aufstrebenden Videospielen, Live -Ereignissen, Sportveranstaltungen und anderen neuen Arten von Inhalten besser zu demonstrieren. Um mit dem Trend Schritt zu halten, erleichtert die neue vertikale Videokomponente auf Mobile den Fans, durch Trailer und Clips zu scrollen, die vollständige Show zu sehen oder Inhalte mit anderen zu teilen. Dies erinnert Sie an die unendliche Scrolling und die sehr erfolgreiche kurze Video -Website Ti

Lange vor AGI: Drei KI -Meilensteine, die Sie herausfordern werdenMay 08, 2025 am 11:24 AM

Lange vor AGI: Drei KI -Meilensteine, die Sie herausfordern werdenMay 08, 2025 am 11:24 AMDie wachsende Diskussion der allgemeinen Intelligenz (AGI) in künstlicher Intelligenz hat viele dazu veranlasst, darüber nachzudenken, was passiert, wenn künstliche Intelligenz die menschliche Intelligenz übertrifft. Ob dieser Moment in der Nähe oder weit entfernt ist, hängt davon ab, wen Sie fragen, aber ich denke nicht, dass es der wichtigste Meilenstein ist, auf den wir uns konzentrieren sollten. Welche früheren KI -Meilensteine betreffen alle? Welche Meilensteine wurden erreicht? Hier sind drei Dinge, von denen ich denke, dass sie passiert sind. Künstliche Intelligenz übertrifft die menschlichen Schwächen Im Film "Social Dilemma" 2022 wies Tristan Harris vom Zentrum für humane Technologie darauf hin, dass künstliche Intelligenz die menschlichen Schwächen übertroffen hat. Was bedeutet das? Dies bedeutet, dass künstliche Intelligenz Menschen benutzen konnte

Venkat Achanta über die Plattformtransformation von Transunion und KI -EhrgeizMay 08, 2025 am 11:23 AM

Venkat Achanta über die Plattformtransformation von Transunion und KI -EhrgeizMay 08, 2025 am 11:23 AMDie CTO von Transunion, Ranganath Achanta, führte eine bedeutende technologische Transformation an, seit er sich nach seinem Akquisition von Neustar Ende 2021 dem Unternehmen angeschlossen hat. Seine Führung von über 7.000 Mitarbeitern in verschiedenen Abteilungen hat sich auf u konzentriert

Wenn das Vertrauen in KI springt, folgt die ProduktivitätMay 08, 2025 am 11:11 AM

Wenn das Vertrauen in KI springt, folgt die ProduktivitätMay 08, 2025 am 11:11 AMDer Aufbau von Vertrauen ist für eine erfolgreiche KI -Einführung im Geschäft von größter Bedeutung. Dies gilt insbesondere angesichts des menschlichen Elements innerhalb von Geschäftsprozessen. Mitarbeiter, wie alle anderen, haben Bedenken hinsichtlich der KI und ihrer Umsetzung. Deloitte -Forscher sind SC

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Herunterladen der Mac-Version des Atom-Editors

Der beliebteste Open-Source-Editor

SublimeText3 Englische Version

Empfohlen: Win-Version, unterstützt Code-Eingabeaufforderungen!

SAP NetWeaver Server-Adapter für Eclipse

Integrieren Sie Eclipse mit dem SAP NetWeaver-Anwendungsserver.

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.