Web-Frontend

Web-Frontend js-Tutorial

js-Tutorial Erschließen Sie die Leistungsfähigkeit großer Sprachmodelle mit JavaScript: Anwendungen aus der realen Welt

Erschließen Sie die Leistungsfähigkeit großer Sprachmodelle mit JavaScript: Anwendungen aus der realen Welt

In den letzten Jahren haben Large Language Models (LLMs) die Art und Weise, wie wir mit Technologie interagieren, revolutioniert und es Maschinen ermöglicht, menschenähnliche Texte zu verstehen und zu generieren. Da JavaScript eine vielseitige Sprache für die Webentwicklung ist, kann die Integration von LLMs in Ihre Anwendungen eine Welt voller Möglichkeiten eröffnen. In diesem Blog werden wir einige spannende praktische Anwendungsfälle für LLMs mit JavaScript untersuchen, komplett mit Beispielen, die Ihnen den Einstieg erleichtern.

1. Verbesserung des Kundensupports mit intelligenten Chatbots

Stellen Sie sich vor, Sie hätten einen virtuellen Assistenten, der Kundenanfragen rund um die Uhr bearbeiten und sofortige und präzise Antworten geben kann. Mit LLMs können Chatbots erstellt werden, die Kundenfragen effektiv verstehen und darauf reagieren.

Beispiel: Kundensupport-Chatbot

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function getSupportResponse(query) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Customer query: "${query}". How should I respond?`,

max_tokens: 100,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error generating response:', error);

return 'Sorry, I am unable to help with that request.';

}

}

// Example usage

const customerQuery = 'How do I reset my password?';

getSupportResponse(customerQuery).then(response => {

console.log('Support Response:', response);

});

Mit diesem Beispiel können Sie einen Chatbot erstellen, der hilfreiche Antworten auf häufige Kundenanfragen liefert, die Benutzererfahrung verbessert und die Arbeitsbelastung menschlicher Supportmitarbeiter verringert.

2. Förderung der Inhaltserstellung durch automatisierte Blog-Gliederungen

Die Erstellung ansprechender Inhalte kann ein zeitaufwändiger Prozess sein. LLMs können bei der Erstellung von Blog-Beitragsskizzen helfen und so die Erstellung von Inhalten effizienter gestalten.

Beispiel: Blog-Post-Gliederungsgenerator

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function generateBlogOutline(topic) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Create a detailed blog post outline for the topic: "${topic}".`,

max_tokens: 150,

temperature: 0.7

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error generating outline:', error);

return 'Unable to generate the blog outline.';

}

}

// Example usage

const topic = 'The Future of Artificial Intelligence';

generateBlogOutline(topic).then(response => {

console.log('Blog Outline:', response);

});

Dieses Skript hilft Ihnen, schnell eine strukturierte Gliederung für Ihren nächsten Blog-Beitrag zu erstellen, was Ihnen einen soliden Ausgangspunkt gibt und Zeit bei der Inhaltserstellung spart.

3. Überwinden Sie Sprachbarrieren mit Echtzeitübersetzung

Sprachübersetzung ist ein weiterer Bereich, in dem sich LLMs auszeichnen. Sie können LLMs nutzen, um sofortige Übersetzungen für Benutzer bereitzustellen, die verschiedene Sprachen sprechen.

Beispiel: Textübersetzung

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function translateText(text, targetLanguage) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Translate the following English text to ${targetLanguage}: "${text}"`,

max_tokens: 60,

temperature: 0.3

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error translating text:', error);

return 'Translation error.';

}

}

// Example usage

const text = 'Hello, how are you?';

translateText(text, 'French').then(response => {

console.log('Translated Text:', response);

});

Mit diesem Beispiel können Sie Übersetzungsfunktionen in Ihre App integrieren und sie so einem globalen Publikum zugänglich machen.

4. Komplexe Texte für eine einfache Lektüre zusammenfassen

Das Lesen und Verstehen langer Artikel kann eine Herausforderung sein. LLMs können dabei helfen, diese Texte zusammenzufassen und sie so leichter verdaulich zu machen.

Beispiel: Textzusammenfassung

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function summarizeText(text) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Summarize the following text: "${text}"`,

max_tokens: 100,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error summarizing text:', error);

return 'Unable to summarize the text.';

}

}

// Example usage

const article = 'The quick brown fox jumps over the lazy dog. This sentence contains every letter of the English alphabet at least once.';

summarizeText(article).then(response => {

console.log('Summary:', response);

});

Dieses Code-Snippet hilft Ihnen beim Erstellen von Zusammenfassungen langer Artikel oder Dokumente, die für die Kuratierung von Inhalten und die Verbreitung von Informationen nützlich sein können.

5. Unterstützung von Entwicklern bei der Codegenerierung

Entwickler können LLMs verwenden, um Codeausschnitte zu generieren, die bei Codierungsaufgaben Unterstützung bieten und den Zeitaufwand für das Schreiben von Boilerplate-Code reduzieren.

Beispiel: Codegenerierung

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function generateCodeSnippet(description) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Write a JavaScript function that ${description}.`,

max_tokens: 100,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error generating code:', error);

return 'Unable to generate the code.';

}

}

// Example usage

const description = 'calculates the factorial of a number';

generateCodeSnippet(description).then(response => {

console.log('Generated Code:', response);

});

Mit diesem Beispiel können Sie Codeausschnitte basierend auf Beschreibungen generieren und so Entwicklungsaufgaben effizienter gestalten.

6. Bereitstellung personalisierter Empfehlungen

LLMs können dazu beitragen, personalisierte Empfehlungen basierend auf Benutzerinteressen bereitzustellen und so die Benutzererfahrung in verschiedenen Anwendungen zu verbessern.

Beispiel: Buchempfehlung

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function recommendBook(interest) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Recommend a book for someone interested in ${interest}.`,

max_tokens: 60,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error recommending book:', error);

return 'Unable to recommend a book.';

}

}

// Example usage

const interest = 'science fiction';

recommendBook(interest).then(response => {

console.log('Book Recommendation:', response);

});

Dieses Skript bietet personalisierte Buchempfehlungen basierend auf Benutzerinteressen, die für die Erstellung maßgeschneiderter Inhaltsvorschläge nützlich sein können.

7. Unterstützung der Bildung durch Konzepterklärungen

LLMs können die Bildung unterstützen, indem sie detaillierte Erklärungen komplexer Konzepte bereitstellen und so das Lernen leichter zugänglich machen.

Beispiel: Konzepterklärung

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function explainConcept(concept) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Explain the concept of ${concept} in detail.`,

max_tokens: 150,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error explaining concept:', error);

return 'Unable to explain the concept.';

}

}

// Example usage

const concept = 'quantum computing';

explainConcept(concept).then(response => {

console.log('Concept Explanation:', response);

});

Dieses Beispiel hilft bei der Generierung detaillierter Erklärungen komplexer Konzepte und hilft in pädagogischen Kontexten.

8. Verfassen personalisierter E-Mail-Antworten

Das Erstellen personalisierter Antworten kann zeitaufwändig sein. LLMs können dabei helfen, maßgeschneiderte E-Mail-Antworten basierend auf Kontext und Benutzereingaben zu generieren.

Beispiel: Verfassen einer E-Mail-Antwort

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function draftEmailResponse(emailContent) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Draft a response to the following email: "${emailContent}"`,

max_tokens: 100,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error drafting email response:', error);

return 'Unable to draft the email response.';

}

}

// Example usage

const emailContent = 'I am interested in your product and would like more information.';

draftEmailResponse(emailContent).then(response => {

console.log('Drafted Email Response:', response);

});

Dieses Skript automatisiert den Prozess der Erstellung von E-Mail-Antworten, spart Zeit und sorgt für eine konsistente Kommunikation.

9. Zusammenfassung rechtlicher Dokumente

Rechtsdokumente können umfangreich und schwer zu analysieren sein. LLMs können dabei helfen, diese Dokumente zusammenzufassen und sie leichter zugänglich zu machen.

Beispiel: Zusammenfassung eines Rechtsdokuments

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function summarizeLegalDocument(document) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Summarize the following legal document: "${document}"`,

max_tokens: 150,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error summarizing document:', error);

return 'Unable to summarize the document.';

}

}

// Example usage

const document = 'This agreement governs the terms under which the parties agree to collaborate...';

summarizeLegalDocument(document).then(response => {

console.log('Document Summary:', response);

});

Dieses Beispiel zeigt, wie man komplexe Rechtsdokumente zusammenfasst, um sie verständlicher zu machen.

10. Erklären medizinischer Bedingungen

Medizinische Informationen können komplex und schwer zu verstehen sein. LLMs können klare und prägnante Erklärungen zu Erkrankungen liefern.

Beispiel: Erklärung des medizinischen Zustands

const axios = require('axios');

// Replace with your OpenAI API key

const apiKey = 'YOUR_OPENAI_API_KEY';

const apiUrl = 'https://api.openai.com/v1/completions';

async function explainMedicalCondition(condition) {

try {

const response = await axios.post(apiUrl, {

model: 'text-davinci-003',

prompt: `Explain the medical condition ${condition} in simple terms.`,

max_tokens: 100,

temperature: 0.5

}, {

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

}

});

return response.data.choices[0].text.trim();

} catch (error) {

console.error('Error explaining condition:', error);

return 'Unable to explain the condition.';

}

}

// Example usage

const condition = 'Type 2 Diabetes';

explainMedicalCondition(condition).then(response => {

console.log('Condition Explanation:', response);

});

Dieses Skript bietet eine vereinfachte Erklärung medizinischer Zustände und hilft bei der Aufklärung und dem Verständnis der Patienten.

Die Integration von LLMs in Ihre JavaScript-Anwendungen kann die Funktionalität und Benutzererfahrung erheblich verbessern. Ganz gleich, ob Sie Chatbots erstellen, Inhalte generieren oder bei der Ausbildung helfen, LLMs bieten leistungsstarke Funktionen zur Rationalisierung und Verbesserung verschiedener Prozesse. Durch die Integration dieser Beispiele in Ihre Projekte können Sie die Leistungsfähigkeit der KI nutzen, um intelligentere und reaktionsfähigere Anwendungen zu erstellen.

Fühlen Sie sich frei, diese Beispiele basierend auf Ihren spezifischen Bedürfnissen und Anwendungsfällen anzupassen und zu erweitern. Viel Spaß beim Codieren!

Das obige ist der detaillierte Inhalt vonErschließen Sie die Leistungsfähigkeit großer Sprachmodelle mit JavaScript: Anwendungen aus der realen Welt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Ersetzen Sie Stringzeichen in JavaScriptMar 11, 2025 am 12:07 AM

Ersetzen Sie Stringzeichen in JavaScriptMar 11, 2025 am 12:07 AMDetaillierte Erläuterung der Methode für JavaScript -Zeichenfolge und FAQ In diesem Artikel werden zwei Möglichkeiten untersucht, wie String -Zeichen in JavaScript ersetzt werden: Interner JavaScript -Code und interne HTML für Webseiten. Ersetzen Sie die Zeichenfolge im JavaScript -Code Die direkteste Möglichkeit ist die Verwendung der Ersatz () -Methode: str = str.replace ("find", "ersetzen"); Diese Methode ersetzt nur die erste Übereinstimmung. Um alle Übereinstimmungen zu ersetzen, verwenden Sie einen regulären Ausdruck und fügen Sie das globale Flag G hinzu:: STR = Str.Replace (/fi

Benutzerdefinierte Google -Search -API -Setup -TutorialMar 04, 2025 am 01:06 AM

Benutzerdefinierte Google -Search -API -Setup -TutorialMar 04, 2025 am 01:06 AMDieses Tutorial zeigt Ihnen, wie Sie eine benutzerdefinierte Google -Such -API in Ihr Blog oder Ihre Website integrieren und ein raffinierteres Sucherlebnis bieten als Standard -WordPress -Themen -Suchfunktionen. Es ist überraschend einfach! Sie können die Suche auf y beschränken

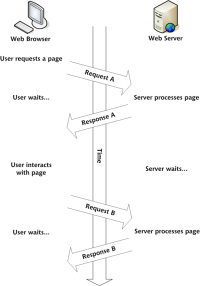

Erstellen Sie Ihre eigenen AJAX -WebanwendungenMar 09, 2025 am 12:11 AM

Erstellen Sie Ihre eigenen AJAX -WebanwendungenMar 09, 2025 am 12:11 AMHier sind Sie also bereit, alles über dieses Ding namens Ajax zu lernen. Aber was genau ist das? Der Begriff AJAX bezieht sich auf eine lose Gruppierung von Technologien, mit denen dynamische, interaktive Webinhalte erstellt werden. Der Begriff Ajax, ursprünglich von Jesse J geprägt

Beispielfarben JSON -DateiMar 03, 2025 am 12:35 AM

Beispielfarben JSON -DateiMar 03, 2025 am 12:35 AMDiese Artikelserie wurde Mitte 2017 mit aktuellen Informationen und neuen Beispielen umgeschrieben. In diesem JSON -Beispiel werden wir uns ansehen, wie wir einfache Werte in einer Datei mit JSON -Format speichern können. Mit der Notation des Schlüsselwertpaares können wir jede Art speichern

10 JQuery Syntax HighlightersMar 02, 2025 am 12:32 AM

10 JQuery Syntax HighlightersMar 02, 2025 am 12:32 AMVerbessern Sie Ihre Codepräsentation: 10 Syntax -Hochlichter für Entwickler Das Teilen von Code -Snippets auf Ihrer Website oder Ihrem Blog ist eine gängige Praxis für Entwickler. Die Auswahl des richtigen Syntax -Highlighter kann die Lesbarkeit und die visuelle Anziehungskraft erheblich verbessern. T

8 atemberaubende JQuery -Seiten -Layout -PluginsMar 06, 2025 am 12:48 AM

8 atemberaubende JQuery -Seiten -Layout -PluginsMar 06, 2025 am 12:48 AMNutzen Sie JQuery für mühelose Webseiten -Layouts: 8 Essential Plugins JQuery vereinfacht das Webseitenlayout erheblich. In diesem Artikel werden acht leistungsstarke JQuery -Plugins hervorgehoben, die den Prozess optimieren, insbesondere nützlich für die manuelle Website -Erstellung

10 JavaScript & JQuery MVC -TutorialsMar 02, 2025 am 01:16 AM

10 JavaScript & JQuery MVC -TutorialsMar 02, 2025 am 01:16 AMDieser Artikel enthält eine kuratierte Auswahl von über 10 Tutorials zu JavaScript- und JQuery Model-View-Controller-Frameworks (MVC). Diese Tutorials decken eine Reihe von Themen von Foundatio ab

Was ist ' this ' in JavaScript?Mar 04, 2025 am 01:15 AM

Was ist ' this ' in JavaScript?Mar 04, 2025 am 01:15 AMKernpunkte Dies in JavaScript bezieht sich normalerweise auf ein Objekt, das die Methode "besitzt", aber es hängt davon ab, wie die Funktion aufgerufen wird. Wenn es kein aktuelles Objekt gibt, bezieht sich dies auf das globale Objekt. In einem Webbrowser wird es durch Fenster dargestellt. Wenn Sie eine Funktion aufrufen, wird das globale Objekt beibehalten. Sie können den Kontext mithilfe von Methoden wie CALL (), Apply () und Bind () ändern. Diese Methoden rufen die Funktion mit dem angegebenen Wert und den Parametern auf. JavaScript ist eine hervorragende Programmiersprache. Vor ein paar Jahren war dieser Satz

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

MinGW – Minimalistisches GNU für Windows

Dieses Projekt wird derzeit auf osdn.net/projects/mingw migriert. Sie können uns dort weiterhin folgen. MinGW: Eine native Windows-Portierung der GNU Compiler Collection (GCC), frei verteilbare Importbibliotheken und Header-Dateien zum Erstellen nativer Windows-Anwendungen, einschließlich Erweiterungen der MSVC-Laufzeit zur Unterstützung der C99-Funktionalität. Die gesamte MinGW-Software kann auf 64-Bit-Windows-Plattformen ausgeführt werden.

ZendStudio 13.5.1 Mac

Leistungsstarke integrierte PHP-Entwicklungsumgebung